2026AI服务器市场趋势与芯片分析

一、2026年AI服务器市场核心趋势

2026年的AI服务器市场呈现出“需求旺盛、架构分化、能效为王”的三大特征。

推理算力需求超越训练,成为市场主导

随着AI应用(如智能体OpenClaw)的爆发式落地,模型推理的需求增速已超过训练。预计到2027年,推理算力在整体智算需求中的占比将超过70%。相应地,AI服务器的市场结构也在转变,尽管2026年训练型服务器仍占约57.3%,但推理型服务器的比重正在快速上升。

算力架构走向专用化,“CPU+GPU+LPU”铁三角形成

单一GPU通用计算已无法满足万亿参数模型的效率要求。以英伟达Vera Rubin平台为代表,市场开始采用分工协同的异构架构:GPU负责高吞吐量的训练与预填(Prefill),而专用的LPU(语言处理单元,如Groq 3)负责低延迟的解码(Decode),CPU负责系统编排。这种“解耦推理架构”将每兆瓦的推理吞吐量提升了35倍。

CPU主控层“去x86化”加速,Arm架构崛起

为了优化每瓦性能和降低对英特尔/AMD的依赖,云巨头(如谷歌、Meta、亚马逊)正大规模部署基于Arm架构的自研CPU。CounterPoint预测,到2029年,在定制化AI ASIC服务器中,Arm架构CPU的份额将从2025年的25%飙升至90%。

整柜交付与液冷成为刚需

随着单机柜功率突破100kW甚至达到230kW(如NVL72),风冷已无法满足散热需求,100%液冷成为高密度集群的必选配置<a href="。同时,服务器厂商(如Dell、HPE)正转型为AI系统集成商,交付预集成液冷、网络与计算的“AI工厂”整柜方案。

二、AI服务器核心芯片元器件构成及数量

一台标准的AI服务器(以当前最前沿的NVIDIA Vera Rubin NVL72机架级架构为例)内部集成了多种专用芯片。以下是核心芯片组成及其在一个典型单元中的大致数量:

芯片类别 |

核心作用 |

具体型号示例 |

数量参考 (以NVL72单机架为例) |

计算芯片 |

GPU (图形处理器):负责AI训练与推理的核心算力。 |

NVIDIA Rubin GPU |

72颗 (每颗包含288GB HBM4内存) |

CPU (中央处理器):负责系统指令调度、数据编排。 |

NVIDIA Vera CPU (Arm架构) / AMD EPYC |

36颗 (通常每2颗GPU配1颗CPU) |

|

LPU (语言处理单元):专用推理加速,降低Token生成延迟。 |

Groq 3 LPU |

256颗 (在独立的LPX机架中) |

|

存储与内存 |

HBM (高带宽内存):紧贴GPU,用于存储模型参数。 |

HBM3e / HBM4 |

单颗GPU配有 8或12个 堆栈,单服务器总计可达 288GB-432GB |

DRAM (系统内存):CPU的主内存。 |

DDR5 / LPDDR5X |

单CPU支持多达 12-24个 DIMM插槽 |

|

NVMe SSD (固态硬盘):用于高速数据存储。 |

EDSFF E3.S |

单台2U服务器可配置 24-40个 |

|

互联与网络 |

NVLink Switch:GPU之间内部高速互联。 |

NVLink 6 Switch |

单机架内包含 9个 交换托盘,提供260TB/s带宽 |

DPU (数据处理单元):卸载网络、存储和安全等“脏活”。 |

BlueField-4 DPU |

每个计算节点配置 1-2颗 |

|

SuperNIC (超级网卡):用于机架间扩展互联。 |

ConnectX-9 SuperNIC |

每个GPU配置 1张,单机架共 72张 |

|

以太网交换机:集群网络核心。 |

Spectrum-6 (CPO) |

集成在交换机机架中,单芯片带宽达 102.4Tb/s |

三、目前AI服务器主要厂商

目前市场主要由原始设计制造商(OEM)、云服务提供商和国产厂商三股势力构成。

全球头部OEM厂商:

戴尔科技:稳居整柜式方案接单龙头,推出基于Vera Rubin和AMD平台的PowerEdge系列。

慧与科技:推出HPE AI Grid解决方案,支持多达128个GPU的私有云部署。

超微电脑:深耕液冷技术,转型为AI基础设施整合商,深受主权云市场青睐。

思科、联想:同样作为Vera Rubin平台的官方合作伙伴。

云服务提供商 (CSP):

亚马逊AWS、微软、谷歌云、甲骨文:除了采购上述厂商的服务器,也在大量部署自研ASIC芯片(如TPU、Trainium)以降低成本和功耗。

中国AI服务器及算力厂商:

根据2026年最新的行业排名,浪潮信息、华为昇腾、新华三、中科曙光、紫光股份等企业在AI算力基础设施领域占据领先地位

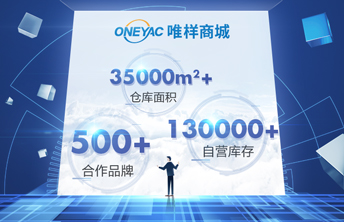

四、唯样商城代理品牌中在AI服务器的应用

唯样商城作为知名的电子元器件授权代理商,代理了众多原厂品牌。在AI服务器中,除了核心的GPU/CPU,周边的无源元件、连接器、电源管理、散热等同样至关重要。以下是在唯样代理品牌中广泛应用于AI服务器的产品推荐:

品牌 |

产品类别 |

在AI服务器中的应用场景 |

高速背板连接器(用于GPU与交换板的互联)、电源连接器(为高功率GPU供电)、散热方案。AI服务器内部线束极其复杂,TE是主要供应商。 |

||

电容器 |

钽电容、陶瓷电容。AI服务器电源模块(VRM)中需要大量高可靠性、高容值的电容来应对GPU负载的剧烈波动。 |

更多代理品牌产品推荐点此

由于AI服务器向高功率密度(每相供电需处理更大电流)和高速互联(PCIe 6.0/7.0)演进,我们要重点关注上述品牌中符合 112G PAM4 信号完整性 要求的高速连接器,以及支持 300W+ GPU供电 的电源模块和电感/电容方案。